-

본 글은 '모두를 위한 딥러닝 시즌 2'와 'pytorch로 시작하는 딥 러닝 입문'을 보며 공부한 내용을 정리한 글입니다.

필자의 의견이 섞여 들어가 부정확한 내용이 존재할 수 있습니다.

We initialized the weights in a stupid way - Geoffrey Hinton

인공신경망 학습에서 중요한 부분 중 하나인, 가중치 초기화! Initialized! 같은 모델을 훈련시켜도 가중치의 초기값에 따라 모델의 훈련 결과가 달라지기도 한다. 즉, 가중치의 초기화가 잘 되어야 딥러닝 성능도 올라가고 기울기 소실과 같은 문제를 완화시킬 수도 있다. 그렇다면, 어떻게 초기화를 해야 할까?

- 일단, 0으로 초기화 하는 것은 굉장히 나쁘다! 잘못하다가는, 역전파를 할 때 모든 기울기 값이 0이 되어서 학습이 불가능 하다.

- 그리고 초기화는 매우 민감하고, 어려운 이슈다.

- 그런데 딥러닝의 아머지라 불리는 Geoffrey Hinton 교수가 RBM이라는 초기화 기법을 선보였다.

1. Restricted Boltzmann Machine (RBM)

restrcted = no connections within a layer

즉, layer 안에서는 연결이 없고 layer와 layer끼리 전부 연결이 있는 모델을 제한된 볼츠만 머신이라고 부른다. 같은 layer안의 노드끼리는 연결이 제한되어 있어서 '제한된'이 붙었다.

훈련 방법은 다음과 같다.

- 1단계 forward : x가 들어왔을 때 y를 만든다. (Encoding)

- 2단계 backward : x'=y가 들어왔을 때, 다시 x를 복원한다. (Decoding)

- 3단계 : 재구성된 값과 원래의 입력 값을 비교하여 평가.

이렇게 3단계를 입력값과 재구성된 값이 최대한 가까워 질 때 까지 반복한다.

그런데 너무 복잡해서 이제는 잘 쓰이지 않는다.

그렇다면, RBM을 사용하지 않고 간단하게, 레이어의 특성에 따라서 다르게 초기화 하는 다른 방법에는 뭐가 있을까?

2. Xavier initialization

세이비어 초기화, 또는 글로럿 초기화라고 한다.

이 방법은 균등 분포, 정규 분포 두가지 경우로 나뉜다.

이전 층의 뉴런 개수와 다음 층의 뉴런 개수를 가지고 식을 세우며, 이렇게 세워진 식 범위 내에서 랜덤하게 수를 가져와서 초기화 한다.

1) Xavier Normal initialization (정규 분포)

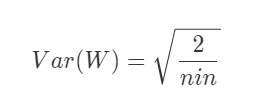

정규 분포로 초기화 할 경우에는 평균이 0이고 표준편차가 var(W)를 만족하도록 해야 한다.

2) Xavier Uniform initilazation (균등 분포)

저 한 덩어리를 m이라고 할 때, -m과 +m 사이의 균등 분포를 의미한다.

- Xavier 초기화는 여러 층의 기울기 분산 사이에 균형을 맞춰서 특정 층이 너무 주목을 받거나 다른 층이 뒤쳐지는 것을 막는다.

- S자 형태인 활성화 함수와 함께 사용할 때에는 좋은 성능을 보이지만, ReLU와 함께 사용할 때엔 성능이 좋지 않다. 즉, 다른 초기화 방법을 사용해야 한다.

3. He initialization

xavier initialization과 유사하게 정규 분포와 균등 분포 두 가지 경우로 나뉜다. 대신, 세이비어 초기화와 다르게 다음 층의 뉴런 수를 반영하지 않는다.

1) He Normal initialization (정규 분포)

정규 분포로 초기화할 경우에는 표준 편차 σ가 위를 만족하도록 해야 한다.

2) He Uniform initialization (균등 분포)

4. 요약

- 시그모이드, 하이퍼볼릭탄젠트 함수를 사용 => 세이비어 초기화

- ReLU 계열 함수 -> He 초기화

ReLU + He 초기화 방법이 좀 더 보편적!

<Reference>

https://deeplearningzerotoall.github.io/season2/lec_pytorch.html

https://steemit.com/kr/@yoonheeseung/2-restricted-boltzmann-machines-rbms

'📚STUDY > 🔥Pytorch ML&DL' 카테고리의 다른 글

09-4. Batch Normalization (0) 2020.03.12 09-3. Overfitting을 막는 방법 (0) 2020.03.10 09-1. 활성화 함수(Activation function) (0) 2020.03.07 08. Perceptron (0) 2020.03.03 07. Tips and MNIST data (0) 2020.03.01 댓글

💾

AtoZ; 처음부터 끝까지 기록하려고 노력합니다✍